Kendinizi bir an için ünlü bir siyasetçi olarak düşünün… İnternette, 10 yıl önce basına kapalı bir toplantıda yaptığınız bir konuşmanın kaydı olduğu söylenen bir videoyla karşılaştınız… O konuşmada neler söylediğinizi hatırlıyorsunuz, fakat videoda ne o gün ne de bugün asla dile getirmeyeceğiniz fikirleri art arda sıralıyorsunuz.

Videoyu izlerken, kendi kendinize sorduğunuz bütün sorulara “evet” cevabı veriyorsunuz: Evet, bu benim 10 yıl önceki halim… Evet, sesim aynı… Evet, dudak hareketleriyle sesler arasında hiçbir uyumsuzluk yok… Evet, bu konuşan benim, fakat ben asla bu cümleleri kurmamıştım.

Doğru, kurmamıştınız ama, muhtemel tekzipleriniz muhtemelen sadece o gün o toplantıda sizi dinleyenleri ikna etmede işe yarayacak. Geri kalanların size düşman olanları videonun sahte olma ihtimalini hesaba katmayıp ânında sizi gömecek, sizi sevenler de ölümcül bir ikilemle karşı karşıya kalıp kendilerine şu soruyu soracak: “Acaba izlediğim video bir ‘deep fake’ (derin sahtelik) üretimi mi, yoksa bizim adam gerçekte bu muymuş?”

Bu çaresizlik kaçınılmaz, çünkü üretilen sahtelik o kadar “gerçek” ki, onun gerçek olmadığını ispatlayabilecek bir teknolojiye henüz sahip değiliz.

Teknoloji yazarı Gavin Sheridan şunları söylerken tamamen haklı: "Hali hazırda kutuplaşmış ve aşırılıkların kol gezdiği sanal ekosistemde, bu teknolojinin tam olarak yerleştiğinde olabilecekleri düşünün. İnsanlar gözlerine ve kulaklarına inanmayı bırakacaklar." (BBC Türkçe, 14 Ağustos 2019).

Fotoğraftan hatta tablodan video üretimi

Deep fake, fotoğraftan (hatta tablodan) yüksek gerçekçiliğe sahip sahte videolar üretilmesine olanak sağlayan bir teknoloji.

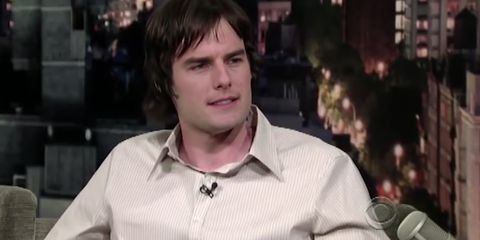

Geçtiğimiz ay BBC, internette viral olan bir deep fake videosu üzerinden konuyu yeniden gündeme getirdi. 2008 tarihli videonun orijinalinde Bill Hader adlı ABD’li komedyen bir talk show’da oyuncu Tom Cruise’un taklidini yapıyordu. Videonun 11 yıl sonraki deep fake teknolojisi uygulanmış halinde ise Bill Hader’ın yüzü bir anda Tom Cruise’un yüzüne dönüşüyor ve “sözde” (!) Tom Cruise kendi sesiyle Hader’ın yerini alıyordu. Fakat öyle bir alıyordu ki, isterse milyonlarca insan izlesin, onun “gerçek” Tom Cruise olduğundan şüphelenen tek bir kişinin çıkması bile mümkün değildi; yani ‘sahte’ o kadar gerçekti.

Deep fake teknolojisinin mucidi ve Tom Cruise’un ‘deep fake’ videosunu üretip servise koyan Slovak vatandaşı Tom (kendisiyle konuşan Guardian’a adını şimdilik açıklamak istemediğini belirtmiş), şimdiye kadar böyle 20 civarında deep fake videosu üretmiş.

Tom, Guardian’a, amacının “Sahte haber ve görüntü çağının geleceği ile ilgili farkındalık yaratmak” olduğunu söylemiş ki, hakikaten, bu teknolojinin yol açabileceği siyasi ve toplumsal sorunları düşünmek bile yeteri kadar ürkütücü.

Yaklaşan ABD seçimlerinde ‘deep fake’ endişesi

Anadolu Ajansı’nın (AA) 16 Eylül’de abonelerine geçtiği bir haber “ABD'deki 2020 seçimlerinde ‘deepfake’ tehlikesi” başlığını taşıyordu.

New York Üniversitesi Stern İş ve İnsan Hakları Merkezi tarafından yayımlanan bir raporun ele alındığı habere göre, “2020 yılında yapılacak ABD seçimlerinde WhatsApp mesajları ve deepfake (derin sahte) videolar, yanlış bilgilerin yayılmasında etkili olabilir”di.

Buradaki ihtimal belirten yüklem tercihinin (“olabilir”), raporun kesin ifadelerden kaçınılması gereken bilimsel bir rapor olmasıyla ilgili olduğu açık. Yoksa, böyle bir teknolojinin, yalan temelli propaganda söz konusu olduğunda atışın serbest olduğu bir dünyada kullanılmama ihtimali herhalde yok. Yani aslında yukarıdaki cümleyi “Yaklaşan ABD seçimlerinde WhatsApp mesajları ve deepfake (derin sahte) videolar, yanlış bilgilerin yayılmasında etkili olacak” diye yazmak daha doğru bir ifade olur.

Nitekim Amerikan istihbarat servisleri, ortada ihtimalin ötesinde bir durum olduğunu bildikleri için, bu ayın başında Facebook, Google ve Twitter ile 2020 seçimleri öncesinde alınması gereken önlemleri görüşmek üzere bir araya geldiler.

Facebook’un gerçekle derin sahteyi birbirinden ayıracak yazılım atağı

İnsan ruhunun sansasyonel olana merakı ortada… Şimdinin mükemmel olmayan sahteliklerine bile düşünmeden müşteri olanların, yarının kusursuz sahteliklerini ne büyük bir iştahla mideye indireceklerini hayal etmek zor değil.

Facebook, onların iştahını biraz olsun kesecek ve müstakbel deep fake kurbanlarının “montaj bunlar” itirazlarına destek verecek yeni bir yazılım için kolları sıvamış durumda.

Gelecekşimdi adlı internet sitesinin haberine göre, Facebook, bir videonun deep fake mi yoksa gerçek mi olduğunu ortaya koyacak bir yazılım için açtığı yarışmada tam 10 milyon dolarlık bir ödül açıkladı. Hiç şüphesiz bu cömert teklif, Facebook’un elindeki kişisel verileri ticari olarak kullandırdığının ortaya çıkmasından sonra sarsılan itibarını düzeltme çabasıyla bağlantılı; yine de ödülü kazanacak biri çıkarsa, önümüzdeki yıllarda deep fake marifetiyle şahsiyet suikastına uğrayacak binlerce kişi Facebook’a minnettar kalacaktır.

Demokrasinin standart işleyişi için de büyük tehlike

Deep fake, hiç kuşkusuz sadece bireyler için değil siyaset ve demokrasi için de büyük sorunlar yaratacak.

Konuya dair ilk bilimsel makalelerden birini kaleme alan (Temmuz, 2018) Robert Chesney (Texas Üniversitesi) ve Danielle Keats Citron (Maryland Üniversitesi) makalelerinin başlığını bunu da gözeterek atmışlar: “Derin Sahtekârlık: Mahremiyet, Demokrasi ve Ulusal Güvenlik İçin Yaklaşan Bir Zorluk.”

İki akademisyen, makalelerinin özetinde şöyle diyorlar (çeviri: Selin Çetin, robotik.legal).

“Zararlı yalanlar yeni bir şey değil. Fakat gerçeği çarpıtma yeteneği ‘derin aldatıcı’ teknoloji ile üstel bir adım attı. Bu yetenek, gerçek insanların asla söylemediği ve yapmadığı şeyleri söylemiş ve yapmış gibi gösteren ses ve videoları oluşturmayı mümkün kılıyor. (…) Bireyler ve işletmeler sömürü, tehdit ve kişisel sabotaj biçimleriyle karşılaşacaklar. Demokrasimiz ve ulusal güveniğimiz için de riskler çok büyük.”

Facebook’un açtığı yarışmadan bir sonuç çıkar mı? Bunu şimdilik bilmiyoruz. Fakat çıksa bile, gerek dezenformasyonda “ilk etki”nin kalıcı doğası gerekse de dahil olduğu yankı odasındaki seslerden başka bir şey duymak istemeyen kitlelerin “derin sahte”ye gönüllü olarak gerçek muamelesi yapacak olması nedeniyle, deep fake’in yaratacağı derin zararları ancak kısmen giderebilir.

İnsanoğlu, kendi zekâsının ürettiği büyük sorunlardan biriyle karşı karşıya…